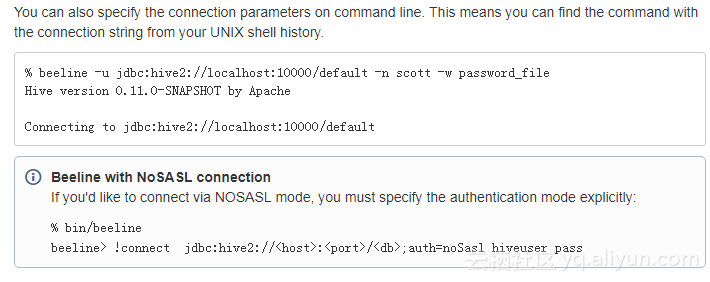

配置hive首先需要安装在hadoop主节点的linux上

需要注意的需要同时安装MYSQL

对于hive安装呢 唯一要注意的就是配置site.xml文件

配置参数 通用的首先就是

javax.jdo.option.ConnectionURL

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://127.0.0.1:3306/hive?createDatabaseIfNotExist=true</value>

<description>JDBC connect string for a JDBC metastore</description>java.jdo.option.ConnectionDriverName

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description>Driver class name for a JDBC metastore</description>java.jdo.ConnectionUserName

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>Username to use against metastore database</description>java.jdo.ConnectionPassword

<name>javax.jdo.option.ConnectionPassword</name>

<value>sa</value>

<description>password to use against metastore database</description>hive.exec.local.scratchdir

<name>hive.exec.local.scratchdir</name>

<value>/usr/tools/apache-hive-2.0.0-bin/tmp</value>

<description>Local scratch space for Hive jobs</description>hive.downloaded.resources.dir

<name>hive.downloaded.resources.dir</name>

<value>/usr/tools/apache-hive-2.0.0-bin/tmp/resources</value>

<description>Temporary local directory for added resources in the remote file system.</description>hive.querylog.location

<name>hive.querylog.location</name>

<value>/usr/tools/apache-hive-2.0.0-bin/tmp</value>

<description>Location of Hive run time structured log file</description>hive.server2.logging.operation.log.location

<name>hive.server2.logging.operation.log.location</name>

<value>/usr/tools/apache-hive-2.0.0-bin/tmp/operation_logs</value>

<description>Top level directory where operation logs are stored if logging functionality is enabled</description>配置完后,使用

schematool -initSchema -daType mysql

最后运行即可

如果报错 可能星有两个hive的site.xml信息配置出错

不然就是mysql有问题

关于hive的使用

确保集群开启

运行 hiveserver2

重新打开一个命令窗口

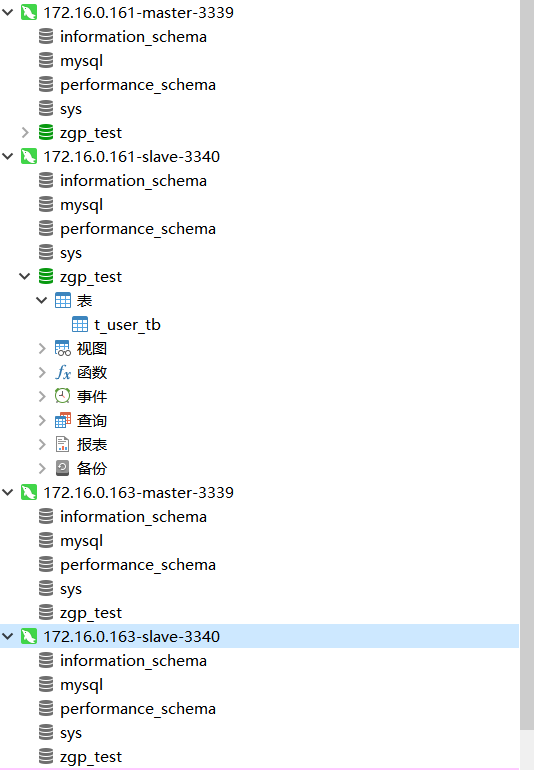

运行beeline

当出现

beeline>则表示运行成功

然后输入!connect jdbc:hive2://localhost:10000

会出现让你输入user和password 当输入完成后 则

会变成

0 : jdbc:hive://localhost:10000>

官网文档为

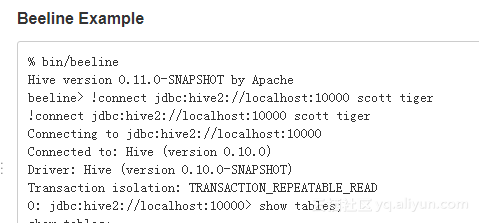

当然你也可以指定链接参数在命令行它的意思就是可以找到你在unix shell命令的历史记录的字符串(所以第一次登录个估计不行吧)

登录进入后

可以执行一些读写操作

比如讲hdfs上的文档写入到数据库中

创建数据库

create database test;

使用 数据库

use test;

创建table

create table docs(line string);

讲HDFS系统上的README.txt 文件写入到docs 表中 以字符串的形式

load data inpath '/reversetext/README.txt' overwrite into table docs;

接下来做一个简单的单词计数

操作为

select explode (split(line,'\s')) from docs;

意思为讲字符串参数 line 用空格分割开来

展示效果为 所有单个单词

接下来聚合单词 讲上条sql作为子令

select word,count(*) from (select explode(split(line,'\s'))as word from docs)a group by word;

这样的展示并未输出写入到hive数据库中或者hdfs中

我们可以通过 下面这条指令 将结果写到table表格中

create table wc_result as select word,count(*) as wccount from (select explode (split(line,'\s'))as word from docs)a group by word;

这条语句中 我们是通过创建table表名为wc_result 将上面的聚合结果当做输入写入到wc_result中 你可以发现 在这个创建的table中没有指定字段.

所以说 hive中是可以不用指定字段,但是问题在于table如何创建的.

运用hive必须会数据语言

DDL 数据定义语言 创建删除表数据库 更改表结构

DML 数据操作语言 对表的增删改查

DQL 数据查询语言 Select ..

DCL 数据库控制语言 grant priliages on , create user..